Specialeffektteknologi har oplevet et sandt boom i de sidste par årtier, hvor CGI bevæger sig fra rudimentært rå og primitiv til næsten ikke skelnes fra virkeligheden. Efterhånden som skabelsen af verisimilitudinøse billeder bliver mere og mere almindelig, forventer både politiske eksperter og strafferetlige eksperter en panik omkring såkaldt 'dyb falsk' teknologi, som har potentialet til yderligere at komplicere en igangværende international diskussion om 'falske nyheder'. Men hvad er nøjagtigt en 'dyb falsk', og hvor stor en trussel vil denne teknologi udgøre i fremtiden?

Ryan Alexander Duke og Bo Dukes

Deep fake (undertiden stiliseret som 'deepfake') teknologi refererer til syntetiserede og / eller overlejrede billeder og / eller videoer skabt af kunstig intelligens ved hjælp af eksisterende billeder og videoer. Ved hjælp af maskinindlæring kunne denne teknologi teoretisk skabe overbevisende optagelser af en person, der udførte en handling, der faktisk aldrig fandt sted i det virkelige liv.

Owen Williams, en professionel softwareingeniør og kunstner for visuelle effekter, tilbød en simpel forklaring.

'Det er en måde at bruge et automatiseret softwaresystem til at erstatte en persons ansigt i en video med et andet ansigt, der er meget mere automatisk og overbevisende, end det havde været muligt med tidligere teknologi,' fortalte Williams Oxygen.com .

Williams bemærkede, at almindelige, populære film som 'Jurassic Park' og 'Blade Runner: The Final Cut' brugte computersoftware til visse scener på måder, der kunne have været en forløber for dybe forfalskninger: 'I filmindustrien er dette virkelig almindeligt. Lad os sige, at du har et tegn, der skal udføre et stunt, og du foretrækker at have deres ansigt synligt. Den klassiske løsning ville være, at du kun ville se dem bagfra, ellers ville deres hår være i deres ansigt, så du ikke kunne fortælle, at det var en dobbelt. Men der er en ret involveret historie om filmskabere, der bruger computere til at sætte en skuespillers ansigt over en stunt-dobbelts. '

'Det plejede at være en meget manuel proces,' fortsatte Williams. 'Nu, med dyb falsk teknologi, giver du en computer to ting: Først den video, du skal erstatte, og derefter en masse input af ansigtet, du skal erstatte med. Du er nødt til at få nok billeder af en person, der laver forskellige ansigtsudtryk og fra forskellige vinkler. Du opretter et bibliotek med, hvordan denne persons ansigt kan se ud i forskellige situationer, og derefter går computeren igennem og ser på videoen. Det har heller ikke brug for et nøjagtigt match. Det kan klemme og morph, hvad det har i biblioteket, så det passer til det, det har brug for. Det, der tidligere krævede snesevis af kunstnere hundreder af timer for at prøve at udføre en virkelig kompliceret effekt nu, er kun et tryk på en knap. '

En facet af denne teknologi, der bekymrer folk, er, at en person ikke nødvendigvis behøver at frivilligt indsende deres ansigt for at denne proces skal udføres, i betragtning af hvor mange billeder der findes online af de fleste mennesker - især berømtheder og politiske figurer.

'Der er nok billeder af enhver berømthed i tilstrækkelige vinkler til, at du kan oprette det bibliotek [uden samtykke],' sagde Williams. 'Der kræves en vis mængde arbejde for at gøre det, men for enhver marginalt populær figur vil der eksistere ting. Min fornemmelse er, at det er mindre sandsynligt, at dette ville være som muligt for en almindelig person. '

De første dybe falske videoer dukkede op på Reddit-fora i slutningen af 2017, ifølge Variety . En bruger hævdede at have brugt sin computer til at skabe meget realistiske pornografiske videoer af forskellige berømtheder, der var involveret i seksuelle aktiviteter, der faktisk aldrig skete i det virkelige liv. Brugeren hævdede, at han fodrede sin computer tusindvis af fotos af stjernerne, hvorfra AI kunne hente ansigtsudtryk og bevægelser afbildet. En app brugt af dybe falske skabere og delt på Reddit blev til sidst downloadet over 100.000 gange. (Reddit ville til sidst fortsætte med at forbyde denne form for indhold og sagde, at det krænkede deres politik for 'ufrivillig pornografi'. ifølge The Verge .)

Den realisme, dette medium kan opnå i øjeblikket, betvivles af Williams.

'Hvis du nogensinde har set en af disse dybe forfalskninger ... er der en vis underlighed der,' sagde Williams. 'De er ikke polerede. Det vil sandsynligvis blive bedre og bedre, især fordi Hollywood har en interesse i at gøre dette automatiseret i stedet for at betale dyre kunstnere. '

Tilsvarende gættede Williams det på trods af panikken omkring dyb falsk porno betyder de skiftende kulturelle holdninger omkring karakteren af hævnporno eller lækkede nøgenbilleder, at det sandsynligvis er mennesker, der skaber denne type medier, vil blive fordømt og ikke fejret, selv inden for voksenunderholdningsindustrien.

'Det bliver aldrig almindeligt,' teoriserede Williams. 'Efter ' The Fappening 'der skete noget på Reddit, folk var i stand til at ændre samtalen og sige,' Dette er ikke en skandale, det er en sexforbrydelse. ' Så jeg kan bare ikke se, at dette bliver så meget af en skandale, som folk tror, det vil. Folk kan også temmelig let finde den originale porno, hvorfra den dybe falske blev oprettet, hvilket betyder, at det er ret let at debunkere. '

det er altid solrigt dennis seriemorder

Men det forårsager ikke bare bekymring, fordi det kunne bruges til at skabe falsk berømthedsporno. Folk er også bekymrede over de politiske konsekvenser.

Politiske eksperter begyndte at skrive om spredning af dybe forfalskninger i 2018. En Guardian-artikel fra november samme år bemærkede den virale spredning af en video, der angiveligt skildrer præsident Donald Trump, der tilskynder den belgiske nation til at trække sig tilbage fra Paris-klimaaftalen. Dette katalyserede en større diskussion om potentialet for forskellige regeringer til at bruge denne teknologi i massedisinformationskampagner, en samtale, der allerede var startet takket være den igangværende undersøgelse af Ruslands involvering i præsidentvalget i 2016 i USA.

Panikken omkring dybe forfalskninger inspirerede endda redaktionen i Bloomberg Media Group til at skrive en stærkt formuleret op-ed om sagen.

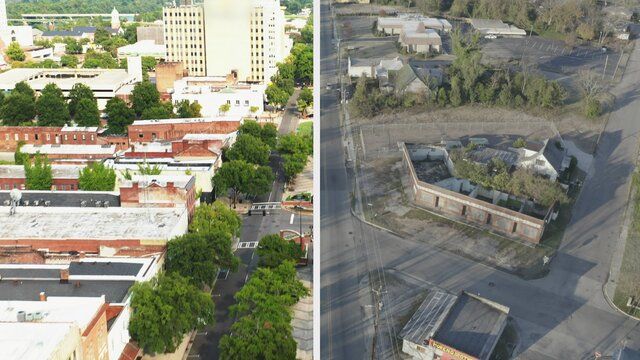

kristne og newsom fotos af gerningssteder

'Videobevis er blevet en søjle i det strafferetlige system ... netop fordi film virker som en sådan pålidelig oversigt over nogens tale eller handlinger. Dybe forfalskninger kunne muligvis gøre sådanne beviser mistænkelige, ' skrev de i juni 2018. 'En overordnet udfordring vil derfor være at identificere og udråbe disse forfalskninger - hvis det er muligt.'

Williams var enig i, at naturen af dybe forfalskninger truer vores forestillinger om 'virkelighed' med hensyn til videobeviser, men bemærkede, at dette juridiske hengemyr ikke er unikt for vores moderne digitale landskab.

'Det kommer slags ned på denne idé, at folk har den video lig med sandhed, hvilket aldrig har været tilfældet. Vi vidste dette fra Rodney King og fremefter. Eller tænk på Eric Garner : Folk troede [den officer, der dræbte ham] var uskyldig, uanset hvilken video af hændelsen forudsagde. For mig [en masse frygt omkring dybe forfalskninger] virker noget ubegrundet. '

Williams angav adskillige andre hændelser, der ikke involverede dyb falsk teknologi, der viste måder, hvorpå video er modigt manipuleret for at skæve den offentlige mening om et spørgsmål James O'Keefes kontroversielle fjernelse af ACORN og en nylig skandale, der involverede doktreret video, der angiveligt viser CNN-reporter Jim Acosta, der angriber en medarbejder i Det Hvide Hus .

Williams 'ultimative konklusion var, at hysteriet omkring dybe forfalskninger er noget overdrevet.

”Det jeg ser ske er, at det fungerer begge veje. Hvis en video kommer ud, og den er ægte, vil folk hævde, at den er falsk. Hvis en video kommer ud, og den er falsk, vil folk hævde, at den er ægte. Hver sag antager en vis mængde sandhed tildelt video [sig selv]. Det er svært at vide, hvilken retning alt dette vil gå i. Hvis Tæbebåndet faktisk kom ud, for eksempel ved du nøjagtigt, hvad der ville ske: Halvdelen af folket ville sige, 'Dette er tyr - t, det er en eller anden skuespiller!' og halvdelen af folket sagde: 'Der er det! Det er rigtigt!' Så intet ville virkelig ændre sig. Det har tendens til at være, hvad der sker med ny teknologi: Ting ændrer sig ikke så meget som folk tror. '

[Foto: SAUL LOEB / AFP / Getty Images]